Графические процессоры (GPU) считаются одним из важнейших компонентов вычислительных систем, который обеспечивает ресурсы для решения различных задач. Они находят применение в видеоиграх, нейронных сетях, научной деятельности, больших данных (Big Data), криптографии и множестве других направлений. В этой статье мы рассмотрим, что представляют собой GPU, принципы их работы и причины, по которым они стали важным аспектом современных технологических достижений. Так как GPU часто используют для анализа данных и обучения моделей, полезно дополнительно разобрать, что такое Data Science.

Понимание GPU и способы их применения

Graphics Processing Unit – это особый тип процессора, созданный для управления графической информацией и визуальными объектами. Это устройство обеспечивает основную функциональность для создания качественной графики и обработки информации. Такие возможности особенно ценятся среди геймеров, дизайнеров, ученых и прочих специалистов. Если вам интересна практическая сторона визуализации, отдельно почитайте, что такое CGI-графика и где она используется.

Главное достоинство графических процессоров заключается в их архитектуре, состоящей из множества ядер, которые способны выполнять тысячи вычислительных операций одновременно. Благодаря таким характеристиками GPU можно считать оптимальным инструментом для задач, которые требуют параллельной обработки данных.

Графические процессоры активно применяются в самых разных сферах:

- распознавание образов – изучение и интерпретация визуальной информации;

- компьютерная графика – создание фотореалистичных графических эффектов (в том числе освещение, тени и отражения);

- Big Data – исследование и управление большими объемами данных;

- наука – исследовательская деятельность и разработка автономных технологий;

- финансы – аналитика и моделирование для проведения сложных расчетов и предсказаний. Если интересна прикладная сторона аналитики, посмотрите, как использовать Data Science в бизнесе и где она дает практический эффект;

- глубокое обучение – разработка продвинутых нейронных сетей и их вычислительная работа в режиме реального времени. На пользовательском уровне возможности AI хорошо видны в поисковых продуктах, например в сервисе Perplexity;

- виртуальная и дополненная реальность – создание реалистичных и интерактивных виртуальных пространств;

- общие вычисления (GPGPU) – аналитические расчеты, симуляции и прочие задачи.

Эти примеры демонстрируют, как графические процессоры можно применять в разнообразных современных технологиях. Их значимость постоянно увеличивается, открывая все больше перспектив для инноваций и совершенствования в различных сферах.

История появления GPU

Графические процессоры начали появляться в 1990-х годах как средства для обработки 2D-графики. Тогда 3D-эффекты только начинали свое развитие, и GPU эволюционировали вместе с ними. Изначально их использовали в видеоиграх и мультимедийных приложениях.

Термин «графический процессор» впервые был введен компанией NVIDIA в 1999 году. Она выпустила продукт GeForce 256 – первый GPU, способный выполнять трансформации и освещение (T&L) на аппаратном уровне, что значительно улучшило производительность и качество графики. Кроме того, значительный вклад в развитие GPU внесла компания Sony – она установила графический процессор в свою консоль PlayStation еще в 1994 году.

GeForce 256. Изображение: wikipedia.org

Прогресс развития и совершенствования GPU происходил не постепенными улучшениями, а стремительными скачками, которые приводили к значительным изменениям:

- В период с 1995 по 2004 годы в Microsoft ежегодно выпускали новые версии интерфейса DirectX, что стимулировало производителей GPU к внедрению новых технологий и улучшению производительности их продуктов.

- С 2000-х годов GPU начали активно использовать для вычислений общего назначения (GPGPU). Это стало возможным благодаря их новой способности параллельного выполнения сложных задач, за счет оснащения большим количеством вычислительных ядер.

- В 2006 году NVIDIA разработала архитектуру CUDA, благодаря которой GPU можно использовать в научных и инженерных задачах. Это открыло новые перспективы в развитии многопоточных вычислений.

- В 2010 году GPU начали использовать в создании технологий автономного вождения автомобилей. Это стало возможным благодаря улучшенной обработке больших потоков информации в реальном времени.

- В 2012 году в видеокартах NVIDIA появилась технология динамического регулирования тактовой частоты – GPU Boost, которая позволяет оптимизировать производительность и энергопотребление в зависимости от текущих задач.

Развитие GPU продолжает ускоряться – с новыми архитектурами и технологиями. Лидеры этого рынка (в основном, NVIDIA и AMD), постоянно совершенствуют свои продукты, внедряя инновационные функции и улучшая энергоэффективность.

Архитектура GPU

В контексте графических процессоров под словом «архитектура» подразумевается совокупность структурных и функциональных особенностей, которые определяют характеристики устройства. Она включает все компоненты, которые обеспечивают функциональность и уникальные возможности GPU. К ним относятся вычислительные блоки, память, кэш и конвейер рендеринга. Эти элементы постоянно совершенствуются для повышения общей эффективности и производительности устройства.

Современные GPU обладают мощными характеристиками:

- тысячами ядер;

- памятью с высокой пропускной способностью;

- поддержкой параллелизма.

Все это позволяет быстро выполнять множество операций.

Также у большинства GPU реализована архитектура SIMD (Single Instruction Multiple Data), в которой один процессор управления и память инструкций могут выполнять один процесс в любой момент времени. Благодаря такой архитектуре в каждом ядре (которое имеет собственную память) процессы могут происходить одновременно и быстро.

Еще одним важным компонентом архитектуры является Compute Unified Device Architecture (CUDA) – это платформа параллельных вычислений от NVIDIA. Она предоставляет разработчикам специализированный API, который дает возможность эффективно использовать ресурсы GPU без глубоких знаний в сфере графического программирования.

Платформа CUDA включает три основных компонента:

- Поток (ядро). Параллельный процессор, выполняющий математические вычисления с «плавающей запятой». Современные GPU оснащены тысячами ядер CUDA, каждое из которых обладает собственными регистрами.

- Блоки. Группа ядер (потоков), которые могут выполнять задачи как последовательно, так и параллельно. Их логическая группировка обеспечивает эффективное сопоставление данных.

- Сетка ядра. Используется для параллельной обработки больших объемов информации. Одна сетка может содержать тысячи потоков, организованных в блоки. При этом синхронизация происходит на уровне блока, так как они не могут использовать одну и ту же разделяемую память.

Основные виды памяти в архитектуре GPU включают:

- Регистры. Находятся в каждом ядре и предназначены для хранения информации, которая используется в текущих вычислениях. Они обеспечивают быструю и эффективную работу с данными, а также предоставляют память для выполнения операций отдельным потокам (ядрам).

- Память для чтения (Read-only). Встроенная память GPU, которая предназначена для обеспечения быстрого доступа к данным. Процесс чтения из этой памяти происходит быстрее, чем из глобальной памяти.

- Глобальная память. Находится в DRAM устройства. В контексте процессора глобальная память аналогична оперативной памяти.

Разновидности графических процессоров

Графические процессоры делятся на три основных типа:

- Интегрированные (Integrated).

- Дискретные (Discrete).

- Виртуальные (Virtual)

Интегрированные GPU могут интегрироваться в архитектуру центрального процессора (CPU) или быть частью материнской платы. Они обладают только базовой графической производительностью и чаще всего используются в системах, предназначенных для мультимедийных и офисных приложений. К их преимуществам относится простая конструкция и низкая стоимость системы. Это достигается благодаря тому, что они не требуют установки отдельной видеокарты, а также обладают низким энергопотреблением.

Дискретные GPU – это отдельная разновидность видеокарты, которая ставится в материнскую плату. Они имеют повышенную производительность, поэтому их можно использовать для выполнения ресурсоемких задач.

Например:

- обработка графики в высоком разрешении;

- видеомонтаж;

- видеоигры с высоким качеством изображения;

- профессиональный дизайн;

- и прочие.

Эти графические процессоры оснащены собственной видеопамятью и являются основой для создания качественных изображений и высокопроизводительных систем.

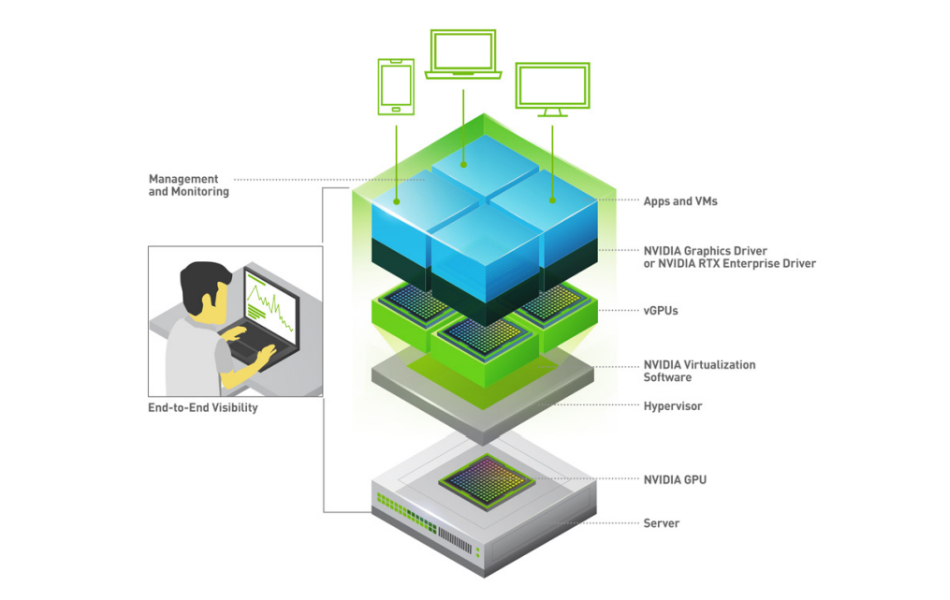

Виртуальные GPU – это программная эмуляция физических графических процессоров, которая предоставляется виртуальным машинам на сервере. Они применяются для визуализации возможностей графической обработки в централизованных вычислительных инфраструктурах. Например, в облачных вычислениях или удаленных рабочих столах. Такие GPU позволяют получить мощности графического процессора без необходимости подключения к физическому оборудованию.

Схема работы виртуального GPU NVIDIA. Изображение: www.nvidia.com

Кроме этих основных типов, существует несколько дополнительных категорий GPU:

- Мобильные GPU. Предназначены для установки и использования в портативных устройствах. Они позволяют продлить время работы от батареи за счет оптимизации производительности и энергоэффективности.

- Игровые GPU. Предназначены для поддержки современных видеоигр и часто оснащены специализированными технологиями (например, адаптивная синхронизация). Они гарантируют высокое качество графики и плавное воспроизведение игрового процесса.

- Профессиональные GPU. Созданы для специализированных задач, которые требуют высокой точности и эффективности. Например, графический дизайн, 3D-моделирование, архитектурное проектирование, видеомонтаж и прочие. Они часто сертифицированы для работы с профессиональными приложениями.

- Научные GPU. Применяются для научных исследований, обработки больших данных и визуализации результатов исследований. Их активно используют в биоинформатике, математике, физике, химии и других сферах.

Таким образом, благодаря наличию множества типов графических процессоров, можно подобрать решение практически для любых потребностей пользователей: начиная от самых простых и заканчивая ресурсоемкими вычислениями. Выбор конкретного типа GPU определяется спецификой его использования, а также требованиями к мощности и энергоэффективности.

Как работают графические процессоры

В основе работы графических процессоров лежит возможность обрабатывать много процессов одновременно. Их архитектура позволяет с высокой эффективностью управлять большими потоками информации. Таким образом GPU могут обеспечивать высокое качество выполнения сложных графических задач – рендеринг изображений, моделирование, анимация и т.д.

Принцип их работы основан на следующих аспектах:

- Параллельная обработка. Благодаря наличию большого количества ядер GPU могут одновременно выполнять вычисления и обрабатывать изображения. Эта способность важна при создании графики, которая содержит большое количество точек и узлов.

- Шейдеры. Это специальные программы, которые определяют визуальные характеристики цифровых объектов. С их помощью можно управлять расцветкой, градиентами и освещением, а также выполнять другие визуальные эффекты программным способом.

- Управление вершинами и пикселями. GPU обрабатывают базовые компоненты графики (пиксели) и координаты в 3D-окружении (вершины), определяя их цвет и расположение в интерфейсе.

- Текстурная и геометрическая корректировка. GPU способен обрабатывать текстуры и накладывать их на объекты. Одновременно выполняются изменения форм и позиций, чтобы правильно расположить и отобразить объекты в интерфейсе.

- Растеризация. Это один из основных процессов для отображения цифровых объектов. Он заключается в конвертации векторной графики в пиксели.

- Вывод на дисплей. GPU создает и выводит изображение на дисплей, обеспечивая высокое разрешение и плавное воспроизведение.

- Видеопамять. Эта память необходима для хранения текстур, шейдеров, результатов вычислений и прочих компонентов графики. GPU использует видеопамять для оперативного доступа к необходимой информации.

Эти базовые принципы работы GPU повышают их эффективность в создании высококачественной графики. Такие технологии позволяют графическим процессорам оптимизировать множество процессов, ускорять сложные вычисления и улучшать пользовательский опыт в разных сферах.

Влияние GPU на современные технологии

Сегодня GPU внедряются практически во всех сферах экономики, науки и жизни. Среди них можно отметить несколько особенно важных направлений.

Визуализация и обработка изображений

Создание графических эффектов и визуализаций является ключевой функцией GPU:

- Графические процессоры используются для создания высококачественной графики в видеоиграх, обеспечивая реалистичные эффекты и плавное воспроизведение.

- GPU помогают в медицинской визуализации, позволяя врачам создавать 3D-модели органов и проводить точную диагностику.

- В научных исследованиях графические процессоры ускоряют обработку больших объемов данных, что помогает ученым в моделировании сложных процессов и анализе результатов.

Эти примеры демонстрируют лишь небольшую часть применения GPU в сфере визуализации.

Игровая индустрия

GPU обеспечивают высокую производительность и позволяют игровым разработчикам проектировать сложные виртуальные пространства. Развитие технологических инструментов, таких как глобальное освещение (Global Illumination), позволяет создавать реалистичные изображения с точной имитацией освещения, теней и отражений.

Виртуальная реальность (VR) также не может функционировать без GPU, которые обеспечивают быструю смену кадров и снижают задержку при их появлении. Это позволяет создать комфортные условия для пользователей, когда система мгновенно реагирует на их движения.

Научные исследования и вычисления

При проведении научных экспериментов и испытаний часто нужно анализировать крупные массивы информации. В этом плане GPU помогают обрабатывать достаточные объемы задач благодаря своей высокой параллельности.

Эта способность востребована в различных дисциплинах:

- В математике – проведение расчетов и обработка числовых моделей за короткий период.

- В физике – моделирование поведения частиц и изменения структуры материалов под воздействием различных факторов, а также определение поведения физических явлений.

- В химии – проверка воздействия молекул и их взаимодействий, моделирование химических реакций, прогнозирование свойств новых соединений и открытие новых материалов.

- В биологии – изучение структуры молекул, исследование геномных данных, симуляции клеточных процессов.

- В геофизике и климатологии – прогнозирование климатических тенденций, симуляции водных экосистем и исследования природных процессов.

Таким же образом, во многих других отраслях GPU позволяют ускорить процесс сбора и анализа данных, оптимизируют моделирование и помогают делать корректные выводы. Благодаря этому можно глубже вникнуть в любой процесс, тем самым стимулировать новые открытия и научный прогресс.

Искусственный интеллект

GPU являются важным инструментом для разработки нейросетей, поскольку для прогресса искусственного интеллекта лучше применять разнообразные техники, включая голосовое общение и графическую обработку.

Графические процессоры ускоряют обучение благодаря возможности выполнять большое количество матричных операций одновременно. Они эффективно используются при обучении нейросетей, в том числе для многократных итераций данных через сеть. Уже появились различные библиотеки, которые позволяют значительно ускорить обучение.

Например:

- TensorFlow.

- PyTorch.

- CUDA.

Такие библиотеки специально адаптированы для работы с GPU и использования их мощных вычислительных ресурсов.

Финансовая аналитика

Финансовые рынки постоянно генерируют огромные объемы данных, а GPU можно использовать для их оперативной обработки. Например, для симуляции различных сценариев, прогнозирования рисков волатильности биржевых активов и управления инвестиционным портфелем.

Промышленность

Графические процессоры находят применение в моделировании производственных систем. Например, динамика жидкостей, механическое проектирование и тепловые процессы. Они являются важным инструментом визуализации в промышленном секторе, что способствует эффективному контролю процессов. Такая визуализация дает возможность корректно оценивать состояние оборудования и принимать оперативные решения.

GPU обеспечивают высокую стабильность в производственных автоматических системах и роботизированных комплексах. Благодаря высокой вычислительной мощности, они улучшают управление оборудованием, делая производство эффективным и надежным.

Медицина

Графические процессоры ускоряют и улучшают интерпретацию медицинских изображений, например, рентгена и КТ. С их помощью можно генерировать трехмерные модели органов для диагностики и планирования лечения. Также GPU оптимизируют исследования генетической информации с целью выявления особенностей, которые предрасполагают к различным заболеваниям.

Таким образом GPU повышают точность диагностики, улучшают возможности лечения и в целом способствуют развитию медицины.

Облачные вычисления

GPU значительно ускоряют вычисления в облачных сервисах. Благодаря своей гибкости, они могут настраивать текущую мощность в соответствии с запросами пользователей. Такая функциональность также важна для облачных игровых платформ, обеспечивающих обработку и стриминг игр с минимальными задержками.

Заключение

Графические процессоры стали важнейшим элементом современных технологий. Благодаря своим уникальным характеристикам, они находят применение в самых разных сферах – от визуализации и обработки изображений до выполнения научных вычислений и машинного обучения. Производители GPU непрерывно улучшают функциональные возможности своих продуктов.

Ежедневно графические процессоры расширяют возможности в технологическом прогрессе и инновациях, влияя на многие аспекты нашей жизни. Будь то научные исследования, медицинские приложения или игровые разработки, GPU продолжают подтверждать свою значимость и потенциал. Постоянное повышение производительности, улучшение энергоэффективности и внедрение искусственного интеллекта свидетельствует о быстром развитии этой технологии.

Изображение на обложке: Freepik