Недавно наткнулась на новость, которая заставила меня задуматься о том, куда на самом деле движется искусственный интеллект.

Этим летом Марк Цукерберг лично предложил исследователю Ришабху Агарвалу присоединиться к новой AI-лаборатории *Meta – с миллионами долларов зарплаты и акций. Цель: создать «суперинтеллект», технологию умнее человека.

Агарвал отказался. И ушёл в никому не известный стартап.

Массовый исход

За последние недели более 20 топовых исследователей покинули *Meta, OpenAI и Google DeepMind. Многие отказались от компенсаций в десятки (а может, и сотни) миллионов долларов.

Все они пришли в Periodic Labs – стартап, который не гонится за AGI, а хочет ускорить научные открытия в физике и химии с помощью AI.

И вот тут начинается интересное.

Искусственный интеллект открывает новую эру для науки.

Философский спор о будущем AI

Сейчас вся Кремниевая долина одержима идеей, что большие языковые модели (LLM) – это путь к научным прорывам. OpenAI и *Meta говорят, что их системы уже работают над drug discovery и теоретической физикой.

Звучит круто. Но есть проблема.

Лиам Федус, один из разработчиков ChatGPT, который теперь основал Periodic Labs, говорит прямо: «Кремниевая долина интеллектуально ленива».

Его тезис простой: чат-бот, даже самый умный, не может делать научные открытия, просто читая учебники.

Почему? Потому что наука – это не только теория. Это тысячи неудачных экспериментов перед одним успешным. Это интуиция, которая приходит от работы с реальными материалами. Это случайные открытия, которые происходят, когда что-то идёт не по плану.

«Люди не могут просто сидеть и размышлять несколько дней, чтобы совершить прорыв. Они проводят множество экспериментов – и часто так ничего и не находят», – добавляет Экин Догус Кубук, второй основатель (бывший Google DeepMind).

Чтобы совершить открытие, ИИ должен уметь проводить эксперименты.

Что они собираются делать

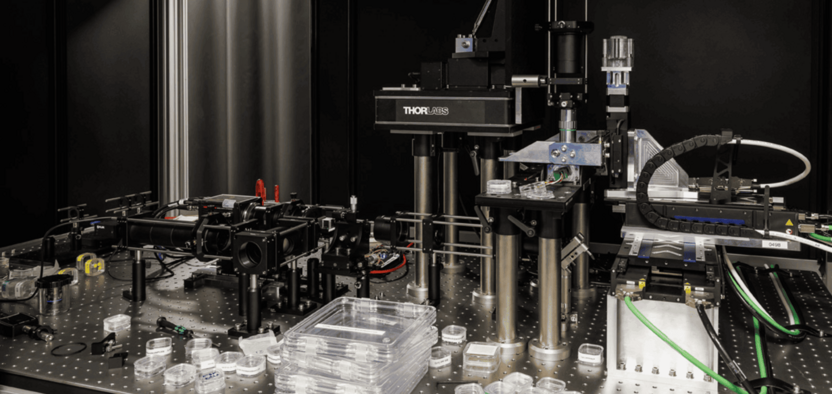

Periodic Labs привлекла $300+ миллионов от a16z и строит лабораторию в Менло-Парк, где роботы будут проводить научные эксперименты в промышленных масштабах.

Схема такая:

- Исследователи формулируют гипотезы.

- Роботы (физические, не виртуальные) выполняют эксперименты: смешивают реагенты, нагревают, тестируют.

- AI анализирует и процесс, и результаты.

- Нейросети учатся находить паттерны успеха.

- Постепенно AI начинает сам проектировать эксперименты.

Пример: робот пытается создать новый сверхпроводник. Проводит тысячи комбинаций порошков, нагревает, тестирует. AI учится предсказывать, какие комбинации сработают.

Не с первого раза. Но через сотни итераций – быстрее, чем люди.

Путь к открытию прокладывают тысячи автоматизированных экспериментов.

Мои мысли

Честно говоря, меня это зацепило по нескольким причинам.

Во-первых, это возвращение к корням. Федус и Кубук по сути повторяют модель легендарных Bell Labs и IBM Research – когда корпорации занимались фундаментальной наукой, а не только продуктами. Сейчас все tech-гиганты хотят быстрых результатов: еще один чатбот, еще одна фича. А эти ребята говорят: «Нет, давайте делать настоящую науку».

Во-вторых, это спор о том, что вообще такое интеллект. LLM умеют предсказывать слова. Но понимают ли они физический мир? Могут ли они интуитивно чувствовать, как ведут себя материалы? Или для этого нужно «пощупать» реальность руками – пусть и роботизированными?

В-третьих, меня поражает, что люди отказываются от сотен миллионов ради идеи. Это либо безумие, либо они действительно верят, что нащупали что-то важное.

Иногда идея оказывается дороже сотен миллионов.

Скептицизм

Конечно, есть и сомнения.

Это адски сложно. Работать с физическим миром на порядки труднее, чем с текстом. Эксперименты стоят дорого, занимают время, могут ломаться.

Это медленно. Орен Эциони из Allen Institute for AI говорит честно: «Решит ли это рак через два года? Нет. Но это правильная ставка на будущее».

Неясно, сработает ли. AI-исследователи пытались делать что-то подобное годами, но только сейчас появились ресурсы для масштаба. Может, и этого не хватит.

Почему это важно для нас

Мне кажется, эта история показывает раскол в AI-сообществе.

Лагерь А: давайте сделаем LLM больше, умнее, дадим им больше контекста – и они станут AGI.

Лагерь Б: AI должен учиться от реального мира, как дети. Недостаточно читать книги про физику – нужно ронять вещи, смешивать краски, обжигаться о горячее.

Второй подход ближе к тому, как учимся мы сами. И, возможно, именно он приведет к настоящему прорыву.

Чтобы совершить прорыв, ИИ должен учиться как ребенок – на собственном опыте.

Что дальше

Пока одни строят чатботы-суперинтеллекты, другие строят роботов, которые будут делать то, что делают ученые в лабораториях – только в тысячу раз быстрее и дешевле.

Кто окажется прав – покажет время. Но факт, что 20+ топовых исследователей проголосовали ногами (и деньгами), говорит о многом.

Возможно, будущее AI – это не «один большой мозг в дата-центре», а миллионы роботов, которые тихо и методично перебирают варианты в реальных лабораториях. Пока мы спорим о том, осознает ли себя GPT-7, они найдут лекарство от рака или новый материал для батарей.

И это, как по мне, гораздо круче.

P.S. Жду ваших мыслей в комментариях. Правы ли ребята из Periodic Labs или это очередной хайп? Может ли AI делать науку без физических экспериментов? Или мы действительно упустили что-то важное, гонясь за универсальными LLM?

*Meta Platforms Inc. признана экстремистской организацией и запрещена на территории РФ.

Комментарии