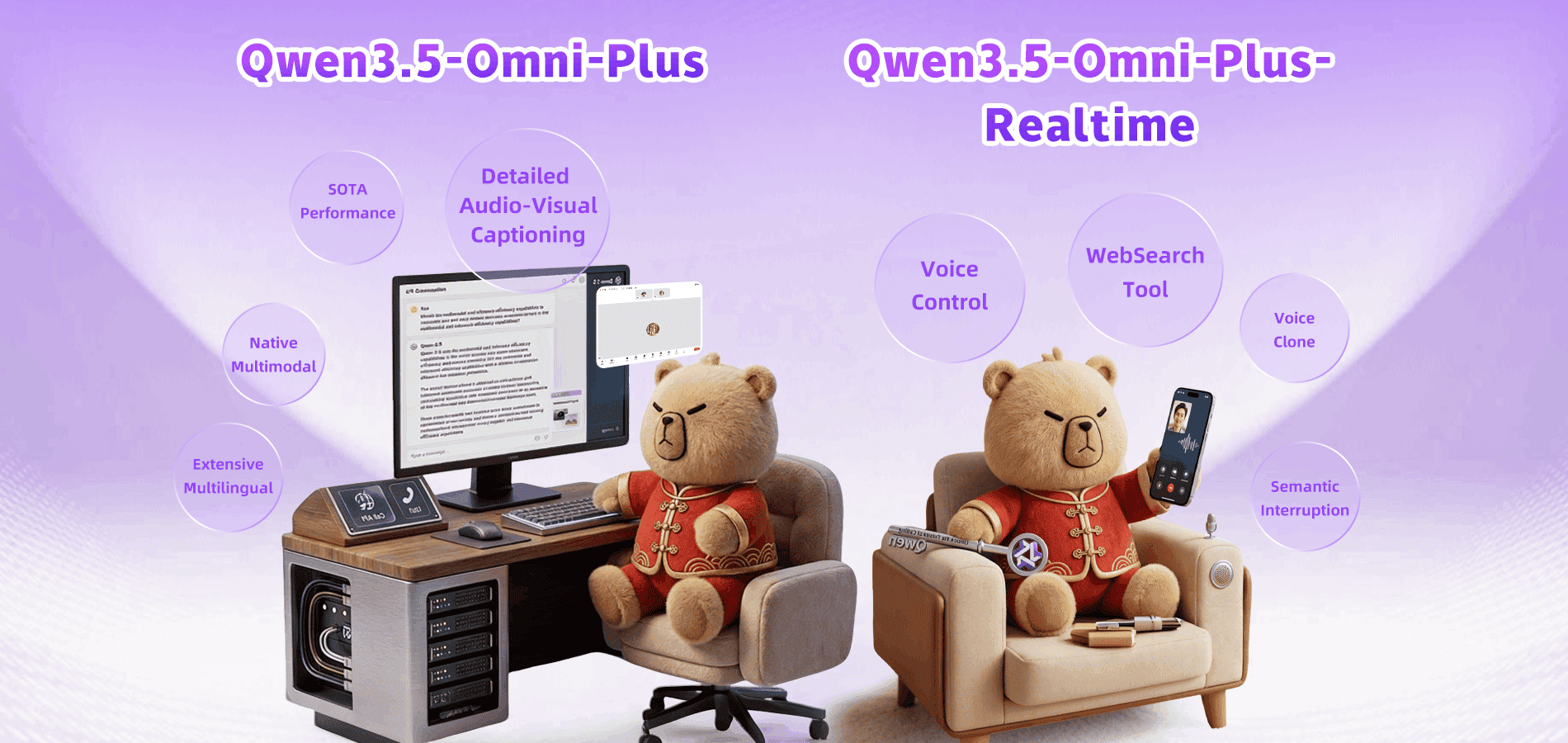

Alibaba представила новое поколение мультимодального Qwen3.5-Omni – модель может одновременно работать с текстом, изображениями, аудио, видео и отвечать в реальном времени текстом и голосом.

У модели увеличилось контекстное окно: теперь система может анализировать до 10 часов аудио или несколько минут видео за один запрос. Существенно расширилась и языковая поддержка: распознавание речи охватывает более 100 языков и диалектов.

Также модель научилась распознавать, когда пользователь действительно обращается к ней, и управлять голосом – менять темп, громкость и эмоциональную окраску. Дополнительно реализованы функции веб-поиска и вызова внешних инструментов прямо в процессе диалога. Большое внимание уделили качеству речи: технология ARIA синхронизирует текст и голос, устраняет типичные ошибки вроде проглатывания слов или некорректного произношения чисел.

Самая неожиданная часть обновления – опция Audio-Visual Vibe Coding. С ее помощью модель может анализировать запись экрана с голосовыми комментариями и на основе этого генерировать рабочий программный код даже без текстового запроса. По словам разработчиков, этот навык не закладывался напрямую и возник как побочный эффект масштабирования.

По ряду тестов новая версия превосходит Gemini – это касается, прежде всего, аудио-задач. Текстовые и визуальные возможности остались на уровне предыдущих моделей линейки.

Qwen3.5-Omni доступна в нескольких версиях и распространяется через API.

Комментарии