Моя лента

Новое

Популярное

262

Онлайн-инструменты для создания субтитров и закадрового текста к видео

В этом материале я собрал инструменты для автоматического создания субтитров и преобразования текста в речь, доступные в России в 2026 году.

225

Как отключить или навсегда удалить чат‑бота в MAX: инструкция

Как корректно убрать виртуального сотрудника в MAX, не сломав интеграции и не потеряв полезную информацию? Рассказываем по шагам.

118

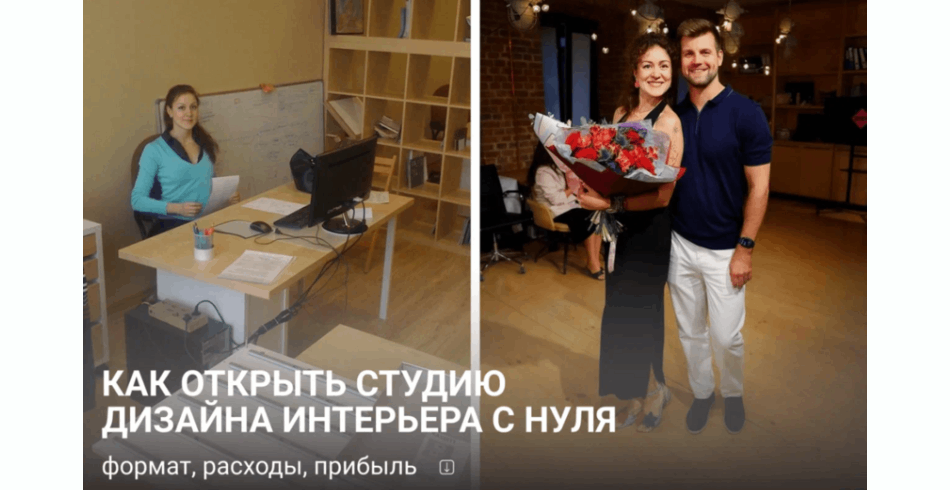

Как открыть студию дизайна интерьера с нуля: формат, расходы, прибыль

Пошаговый разбор, как открыть студию дизайна интерьера. Собрали в одной статье всё для запуска стабильного бизнеса: регистрация ИП, стартовые вложения, бизнес-план студии, структура команды и расчет точки безубыточности.

133

Цифровые двойники: как виртуальные копии объектов помогают бизнесу снижать издержки и прогнозировать риски

В этой статье разберем суть технологии цифровых двойников, рассмотрим основные подходы к созданию таких моделей и их разновидности. Также поговорим о том, в каких отраслях они применяются и какие задачи решают на практике.

168

Нейросеть для написания писем: ТОП-7 лучших ИИ-сервисов для переписки

ИИ для написания писем – это универсальный ассистент, доступный каждому, у кого есть доступ к интернету. Он помогает избежать грамматических ошибок, убирает лишнюю эмоциональность или, наоборот, добавляет тексту вежливости и эмпатии.

Вакансии в Timeweb

PHP Developer (middle)

🏰 Санкт-Петербург 💷 Зарплата: от 150 000 руб. на руки 💪 Опыт: 3-6 лет 💼 Полная занятость, можно удаленно

Python Developer

🏰 Санкт-Петербург 💷 Зарплата: обсуждается 💪 Опыт: 3-6 лет 💼 Полная занятость, гибридный формат работы

Product Owner / Менеджер продукта MyReviews

🏰 Санкт-Петербург 💷 Зарплата: обсуждается 💪 Опыт: 1-3 года 💼 Полная занятость, гибридный формат работы

Lead / Senior JavaScript developer

🏰 Санкт-Петербург 💷 Зарплата: обсуждается 💪 Опыт: 3-6 лет 💼 Полная занятость