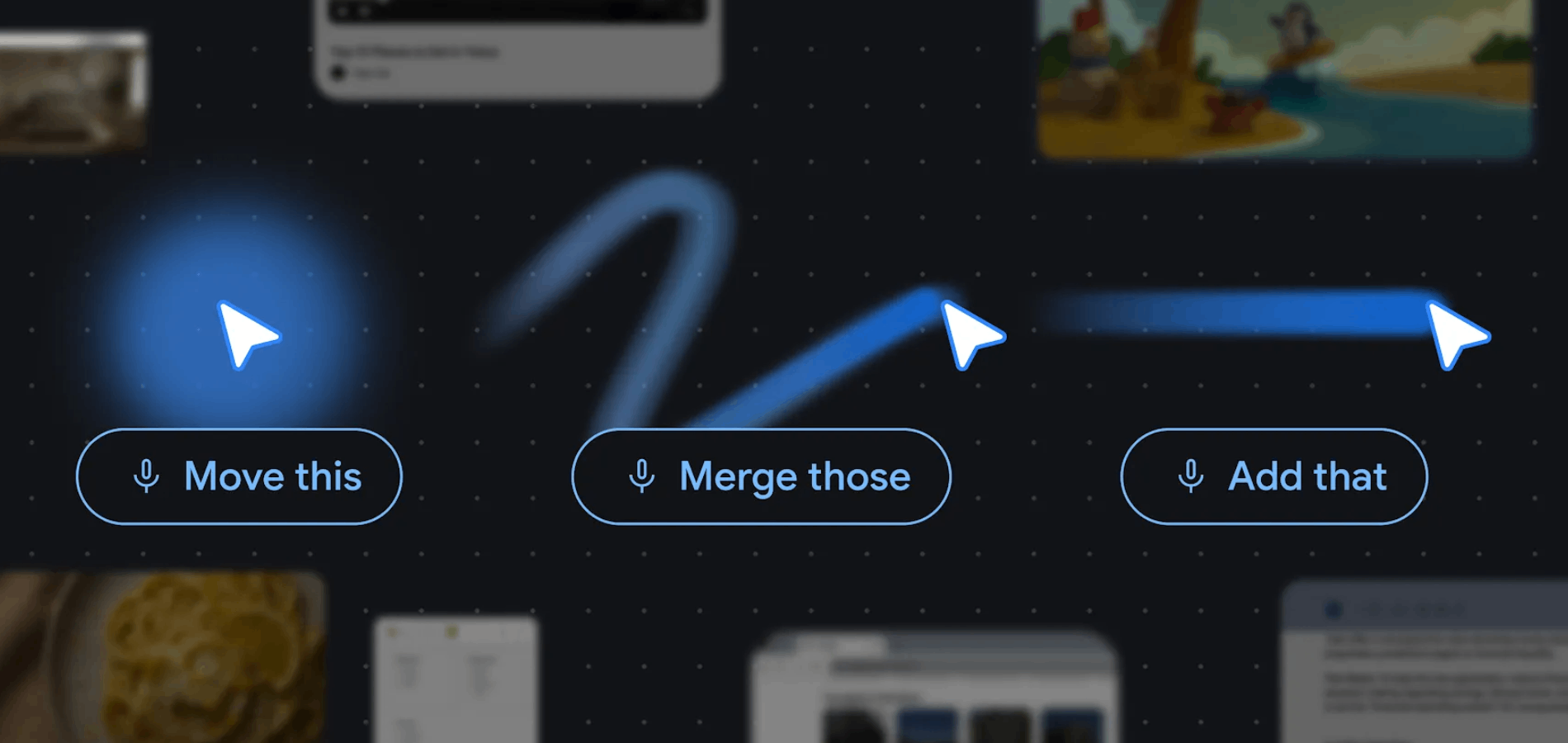

Google и команда DeepMind представили концепцию ИИ-интерфейса, в котором обычный курсор мыши превращается в полноценный инструмент взаимодействия с Gemini.

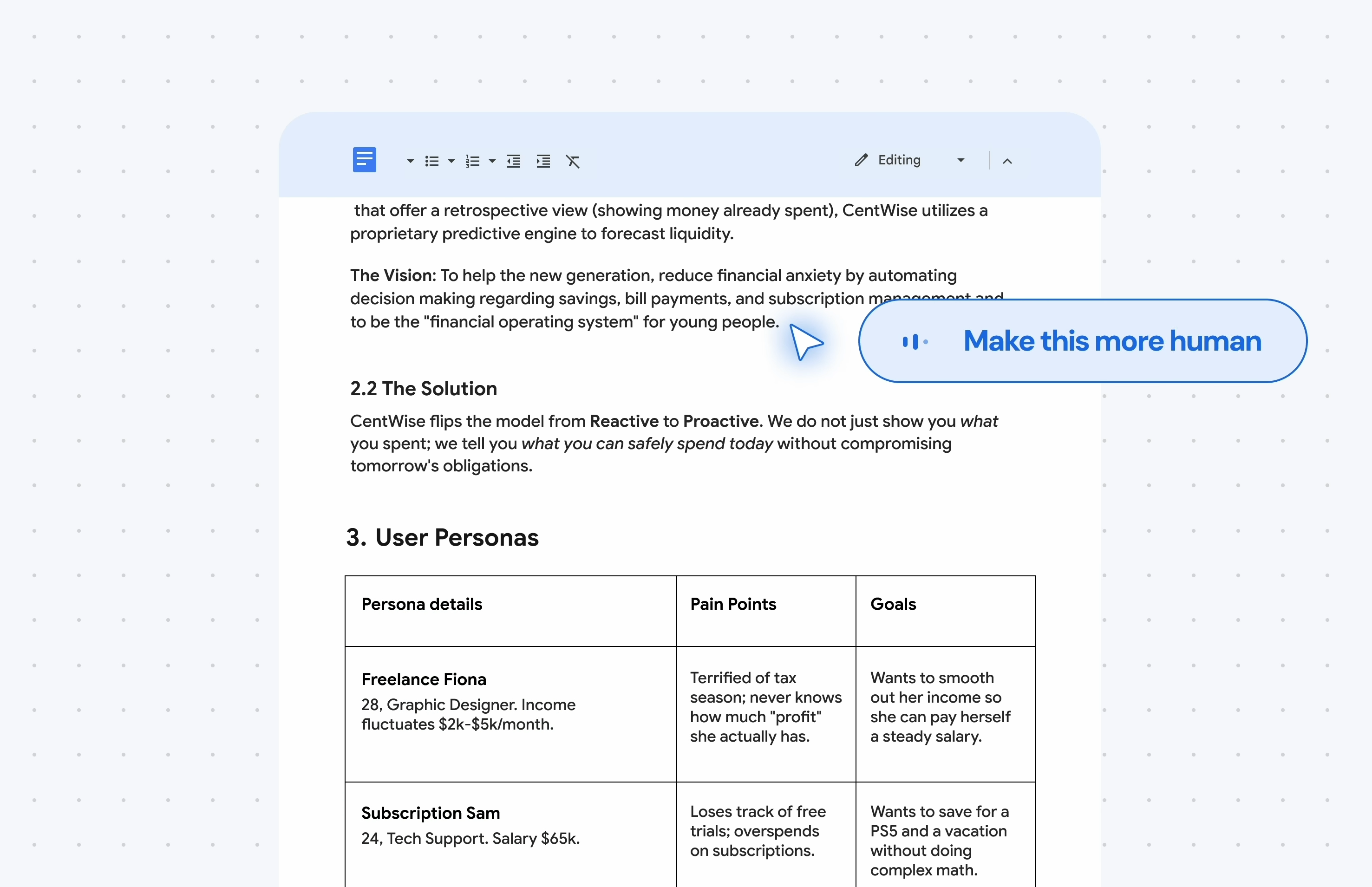

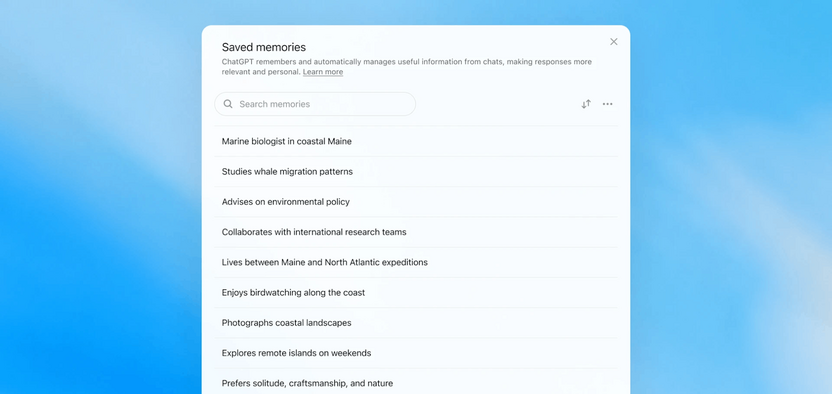

Новая система позволяет ИИ понимать объект под курсором – изображение, текст, PDF-файл, таблицу или элемент интерфейса. Пользователю больше не нужно составлять длинные запросы в отдельном окне чат-бота. Вместо этого можно указать на объект и дать короткую команду: «сравни это», «объясни это» или «перемести в папку».

В DeepMind считают новый способ общения с ИИ более человеческим, так как жесты и контекст для пользователя зачастую важнее длинных объяснений. Например, система сможет распознать здание на фотографии и сразу построить маршрут, кратко пересказать выделенный PDF-документ или автоматически преобразовать таблицу в диаграмму. В одном из демонстрационных сценариев кадр из туристического видео превратился в ссылку на бронирование ресторана, который распознал Gemini.

Источник: Google (здесь и на обложке)

Разработчики выделяют четыре главных принципа концепции: работа ИИ без отвлечения от текущих задач, взаимодействие через контекст, использование коротких команд и превращение пикселей в интерактивные объекты.

Часть этих возможностей уже начинает появляться в Google Chrome. Пользователи смогут задавать Gemini вопросы о конкретной части страницы с помощью курсора. В будущем похожие функции появятся в устройствах Googlebook через систему Magic Pointer.

Комментарии