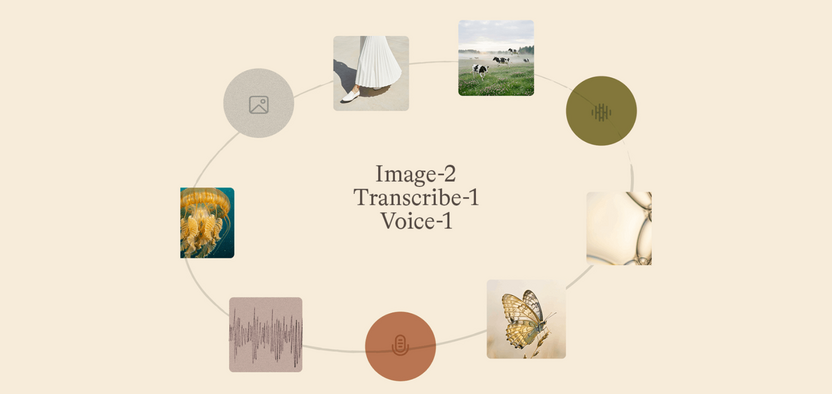

Alibaba выпустила новую модель генерации изображений Qwen-Image-2.0 – нейросеть нацелена на профессиональное создание и редактирование визуального контента и напрямую конкурирует с Google Nano Banana Pro. Разработка объединяет сразу два направления, которые раньше существовали раздельно: высокоточную генерацию изображений и аккуратное редактирование без разрушения исходной композиции.

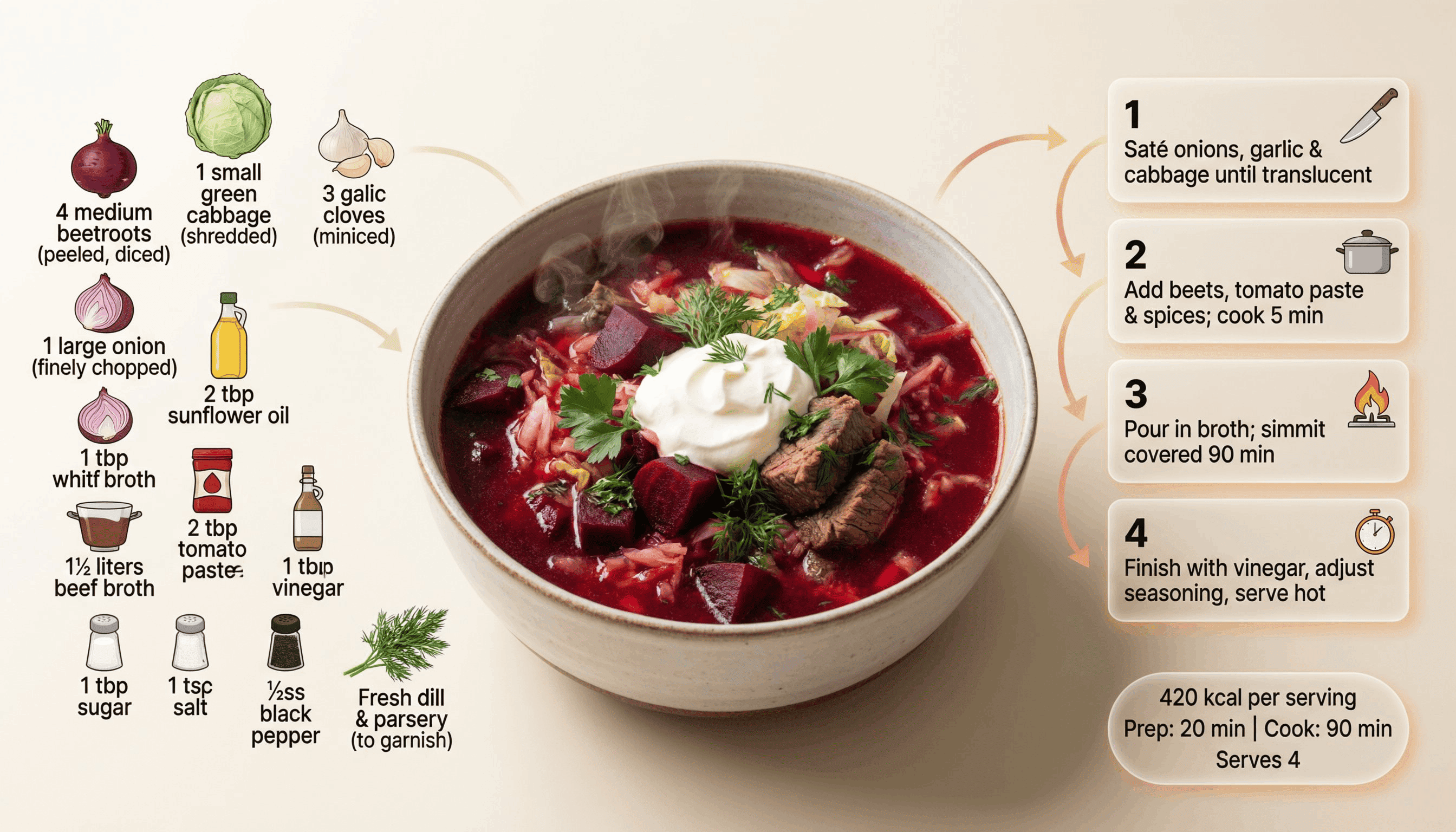

Qwen-Image-2.0 отлично работает с текстом внутри изображений. Модель корректно рендерит надписи, поддерживает разные стили и умеет гармонично размещать текст в макетах. Поэтому она подходит и для иллюстраций, и для практических задач – постеров, презентационных слайдов, инфографики и комиксов. Поддерживаются детализированные запросы длиной до тысячи токенов, поэтому можно описывать сложные композиции с точной структурой.

Модель обладает нативным разрешением 2K и делает упор на фотореализм. В Alibaba отмечают, что Qwen-Image-2.0 хорошо справляется с комбинированием текста и изображения, например, в кинопостерах или многостраничных комиксах с сохранением внешности персонажей и логики диалогов.

Источник: Qwen-Image-2.0 (здесь и на обложке)

Архитектура модели облегчена до 7 млрд параметров, благодаря чему она быстро генерирует и внедряется в продакшн-сценарии. При этом Qwen-Image-2.0 поддерживает единый рабочий процесс: пользователи могут создавать изображения с нуля и редактировать уже готовые – добавлять элементы, менять текст или склеивать несколько сцен без переключения между инструментами.

В слепых тестах на платформе AI Arena модель показала высокие результаты. В задачах генерации изображений ее опередили лишь Google Gemini-3-Pro-Image-Preview и OpenAI GPT Image 1.5, а в редактировании Qwen-Image-2.0 уступила только флагманской версии Gemini.

Доступ к модели открыт через тестовый API на платформе Alibaba Cloud BaiLian и в Qwen Chat.

Комментарии