Моя лента

Новое

Популярное

51

Что такое репосты и как использовать их для продвижения бизнеса

Разберемся подробно: что такое репост, какие функции он выполняет в маркетинге, какие бывают виды репостов, как правильно использовать их в соцсетях и мессенджерах и почему анализ репостов – обязательный элемент контент-стратегии.

108

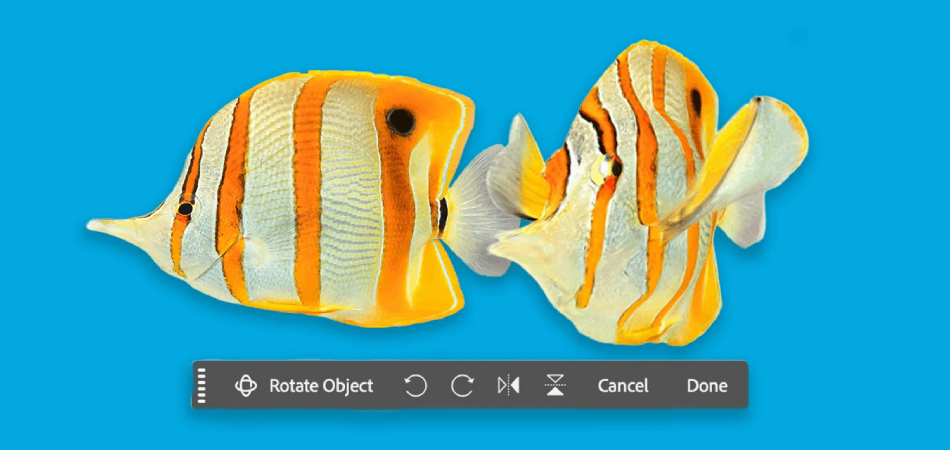

Adobe добавила в Photoshop функцию для преобразования двухмерных объектов в 3D-модели

Adobe анонсировала в своем блоге функцию Rotate Object в бета-версии приложения Photoshop. Инструмент работает на базе ИИ, с его помощью можно быстро конвертировать 2D-объекты в 3D-модели.

112

12 лет неприступности: инженерный гений против безопасности Xbox One – представлен первый аппаратный взлом

На прошедшей конференции RE//verse исследователь кибербезопасности Маркус Гааседелен (известный как «Fritz») представил миру первый действенный метод аппаратного взлома консоли Xbox One, получивший название The Bliss Hack.

121

Pixelpaw Labs представила Phase – мышь, которая превращается в геймпад

Стартап Pixelpaw Labs анонсировал Phase – игровое устройство объединяет функции компьютерной мыши и геймпада и может переключаться между этими режимами благодаря разборной конструкции.

66

Почему таск-менеджмент – ключевой фактор успеха digital-кампаний и агентств

Между гениальной идеей и ее реализацией всегда стоит один фактор – управление задачами. Если ваш digital-отдел до сих пор живет по принципу «договорились в чате» или «это у меня в голове», вы не просто теряете деньги. Вы системно сжигаете ресурсы заказчика и репутацию компании.

Вакансии в Timeweb

PHP Developer (middle)

🏰 Санкт-Петербург 💷 Зарплата: от 150 000 руб. на руки 💪 Опыт: 3-6 лет 💼 Полная занятость, можно удаленно

Python Developer

🏰 Санкт-Петербург 💷 Зарплата: обсуждается 💪 Опыт: 3-6 лет 💼 Полная занятость, гибридный формат работы

Product Owner / Менеджер продукта MyReviews

🏰 Санкт-Петербург 💷 Зарплата: обсуждается 💪 Опыт: 1-3 года 💼 Полная занятость, гибридный формат работы

Lead / Senior JavaScript developer

🏰 Санкт-Петербург 💷 Зарплата: обсуждается 💪 Опыт: 3-6 лет 💼 Полная занятость